Viele Menschen spüren, dass mit der modernen Arbeitswelt etwas nicht stimmt. Wir verfügen über leistungsfähigere Werkzeuge als jede Generation vor uns, können Informationen in Sekunden austauschen und komplexe Prozesse automatisieren. Und dennoch haben viele das Gefühl, ständig beschäftigt zu sein, ohne wirklich voranzukommen.

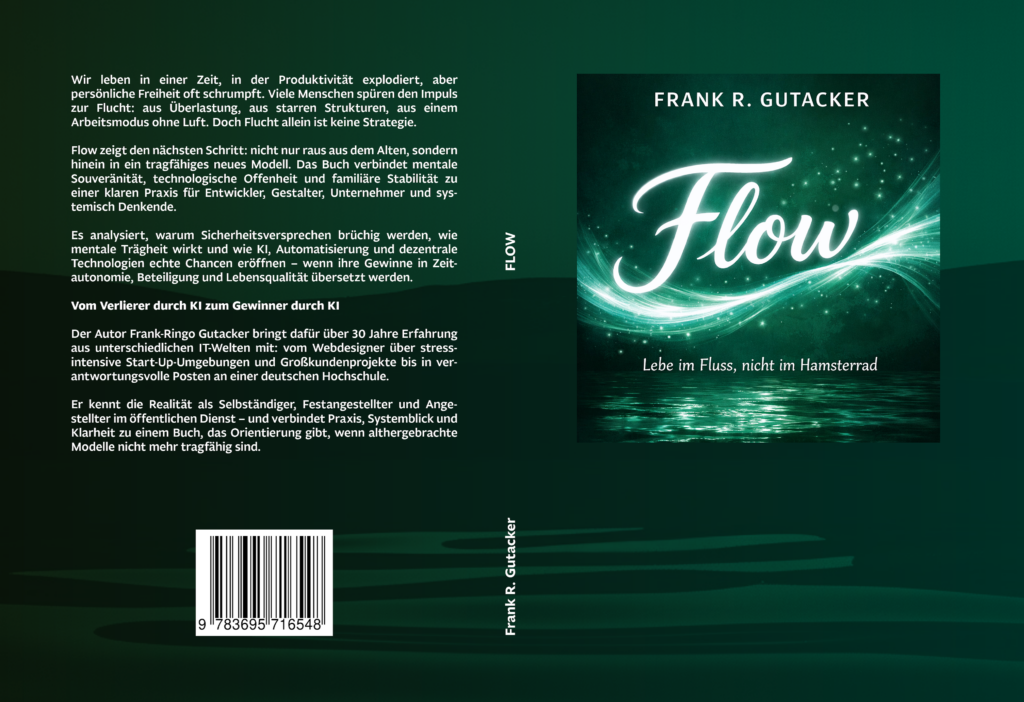

Diese Beobachtung war einer der Ausgangspunkte für mein Buch Flow.

Das Buch Flow entstand aus der Frage, warum Systeme, die eigentlich Entlastung schaffen sollten, in der Praxis häufig das Gegenteil bewirken. Technologie hat unsere Möglichkeiten enorm erweitert, doch gleichzeitig sind die organisatorischen Strukturen, in denen diese Technologien eingesetzt werden, immer komplexer geworden.

Viele Menschen beschreiben diesen Zustand mit einem vertrauten Bild: dem Hamsterrad. Man bewegt sich ständig, erledigt Aufgaben, investiert Energie – und hat dennoch das Gefühl, sich kaum vom Ausgangspunkt zu entfernen.

Dieses Gefühl ist kein individuelles Versagen. Es ist häufig das Ergebnis von Strukturen, die historisch gewachsen sind. Prozesse werden eingeführt, um Probleme zu lösen, und bleiben bestehen, selbst wenn sich die Rahmenbedingungen längst verändert haben. Neue Systeme kommen hinzu, neue Kommunikationskanäle entstehen, neue Anforderungen werden formuliert. Selten wird dagegen gefragt, ob bestehende Abläufe noch sinnvoll sind oder ob sie lediglich fortgeführt werden, weil sie einmal etabliert wurden.

So entstehen Arbeitsumgebungen, die zwar hoch organisiert erscheinen, aber gleichzeitig enorme Reibung erzeugen.

In Flow versuche ich deshalb, einen anderen Blick auf Arbeit zu eröffnen. Es geht weniger darum, Menschen effizienter zu machen, sondern darum zu verstehen, wie Systeme gestaltet sind, in denen Arbeit stattfindet.

Dabei spielen oft drei Kräfte eine Rolle: Gewohnheit, Angst vor Veränderung und ein Loyalitätsdenken, das dazu führen kann, dass eigene Bedürfnisse dauerhaft zurückgestellt werden. In ihrer Kombination stabilisieren diese Faktoren Strukturen, selbst dann, wenn viele Beteiligte spüren, dass sie nicht optimal funktionieren.

Gewohnheit sorgt dafür, dass Dinge so bleiben, wie sie sind. Was einmal Routine geworden ist, wird selten grundlegend hinterfragt. Selbst ineffiziente Prozesse können sich erstaunlich lange halten, wenn sie Teil der täglichen Abläufe geworden sind.

Angst spielt ebenfalls eine wichtige Rolle. Veränderungen bedeuten Unsicherheit. Wer bestehende Strukturen infrage stellt, riskiert Konflikte oder muss Verantwortung für neue Lösungen übernehmen. In vielen Organisationen ist Anpassung deshalb einfacher als Veränderung.

Und schließlich gibt es Loyalität. Viele Menschen fühlen sich ihrem Team, ihrem Unternehmen oder einer Institution stark verbunden. Diese Loyalität kann etwas sehr Positives sein, weil sie Vertrauen und Stabilität schafft. Problematisch wird sie allerdings, wenn sie dazu führt, dass eigene Bedürfnisse dauerhaft zurückgestellt werden.

Wenn diese drei Kräfte zusammenwirken, entsteht eine erstaunliche Stabilität. Systeme bleiben bestehen, auch wenn viele Beteiligte intuitiv spüren, dass sie nicht optimal funktionieren.

Der Begriff „Flow“ steht im Buch deshalb nicht nur für einen persönlichen Zustand konzentrierter Arbeit. Er beschreibt auch eine strukturelle Eigenschaft von Systemen. Gut gestaltete Strukturen ermöglichen Bewegung mit möglichst wenig Reibung. Informationen fließen, Entscheidungen werden dort getroffen, wo sie sinnvoll sind, und Menschen können ihre Fähigkeiten tatsächlich einsetzen.

In technischen Systemen ist dieses Prinzip selbstverständlich. Ingenieure versuchen, unnötige Reibung zu reduzieren, Prozesse zu vereinfachen und Abläufe so zu gestalten, dass Energie möglichst effizient genutzt wird. Überträgt man diesen Gedanken auf Organisationen, ergibt sich eine naheliegende Frage: Warum akzeptieren wir in Arbeitsstrukturen oft eine Komplexität, die wir in technischen Systemen niemals tolerieren würden?

Genau an diesem Punkt setzt das Buch Flow an. Es versteht sich nicht als klassischer Ratgeber, der individuelle Produktivität optimieren will. Es ist vielmehr der Versuch, Arbeit, Organisation und Technologie als gestaltbare Systeme zu betrachten.

Denn Systeme sind keine Naturgesetze. Sie entstehen durch Entscheidungen, durch Prozesse und durch kulturelle Gewohnheiten. Und was von Menschen geschaffen wurde, kann grundsätzlich auch von Menschen verändert werden.

Diese Perspektive ist vielleicht der wichtigste Gedanke des Buches. Die Zukunft der Arbeit wird nicht allein durch neue Technologien bestimmt, sondern durch die Art und Weise, wie Organisationen diese Technologien einsetzen.

Am Ende steht deshalb eine einfache Frage:

Passen wir uns weiterhin an Systeme an, die uns formen – oder beginnen wir damit, Systeme so zu gestalten, dass sie besser zum menschlichen Arbeiten passen?

Wer sich näher für das Buch interessiert, findet weitere Informationen und Bestellmöglichkeiten auf der offiziellen Seite:

https://flow.calypsa.de/buch

Internationale Quellen

- OECD – Future of Work

Internationale Analysen zu Arbeitsmarkt, Technologie und Organisationsstrukturen.

https://www.oecd.org/employment/future-of-work/ - MIT Sloan Management Review – Future of Work

Forschungsbasierte Artikel darüber, wie Technologie und KI Arbeitsorganisation verändern.

https://sloanreview.mit.edu/tag/future-of-work/ - McKinsey Global Institute – Future of Work

Studien zu Produktivität, Automatisierung und strukturellem Wandel der Arbeit.

https://www.mckinsey.com/mgi/our-research/future-of-work

Deutsche Quellen

- Fraunhofer IAO – Zukunft der Arbeit

Forschung zu digitalen Arbeitsstrukturen, Organisation und Technologieeinsatz.

https://www.iao.fraunhofer.de/de/forschung/forschungsbereiche/arbeit-organisation.html - Bundesministerium für Arbeit und Soziales – Zukunft der Arbeit

Analysen und Programme zur Transformation der Arbeitswelt in Deutschland.

https://www.bmas.de/DE/Arbeit/Arbeitswelt-der-Zukunft/arbeitswelt-der-zukunft.html